AI의 정확성: 혁신을 위한 필수 조건인가, 위험의 근원인가?

🤖 AI 추천

AI 기술의 정확성 및 신뢰성 확보에 관심 있는 개발자, AI 연구원, 프로젝트 관리자, 그리고 AI 도입을 검토하는 의사결정권자에게 이 콘텐츠를 추천합니다. 특히 LLM 기반 AI 시스템의 한계와 이를 극복하기 위한 RAG, MRC와 같은 기술적 접근 방식에 대한 이해를 높이고 싶은 분들께 유용합니다.

🔖 주요 키워드

AI의 정확성: 혁신을 위한 필수 조건인가, 위험의 근원인가?

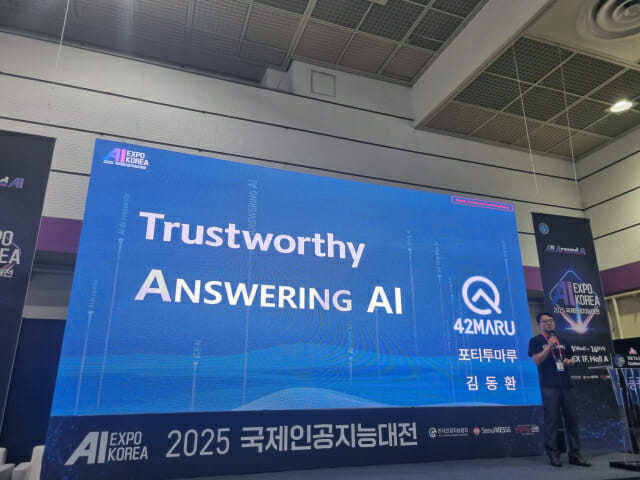

김동환 포티투마루 대표는 '2025 국제인공지능대전'에서 정확성 없는 AI는 혁신이 아닌 리스크라고 주장하며 AI 산업의 핵심 과제로 신뢰성 확보를 강조했습니다.

핵심 기술

거대언어모델(LLM) 기반 AI는 환각(hallucination), 보안, 비용 측면에서 구조적 한계를 가지고 있으며, 확률 기반 언어 생성 방식 때문에 정확도가 80~85% 수준에 머물러 기업 의사결정 및 법적 책임에 위험 요소로 작용할 수 있습니다. 이러한 한계를 극복하기 위해 검색증강생성(RAG)과 기계독해(MRC)를 병행 활용하는 방안이 제시되었습니다.

기술적 세부사항

- LLM의 한계: '챗GPT'와 같은 LLM은 정교한 문장 생성에도 불구하고 사실관계 오류를 포함한 환각 현상을 지속적으로 발생시킵니다. 이는 확률 기반 언어 생성 방식에서 기인하며, 정확도에 한계가 있습니다.

- RAG (Retrieval Augmented Generation): AI가 응답 전에 외부 데이터를 검색하여 환각 가능성을 줄이는 기술입니다.

- MRC (Machine Reading Comprehension): 특정 도메인에 특화된 데이터 학습을 통해 정확도를 높이는 기술입니다.

- LLM vs MRC 비유: LLM은 다방면에 능하지만 평균적인 성과를 내는 학생, MRC는 특정 과목만 깊이 파는 우등생에 비유되며, 목적과 맥락에 따라 선택적 조합이 필요합니다.

- 포티투마루의 'LLM42': 정답 도출 과정의 신뢰성과 책임성을 확보하기 위해 자체 파운데이션 모델을 개발했습니다.

개발 임팩트

- LLM의 정확성 문제를 해결하여 기업의 의사결정 및 법적 책임 리스크를 줄일 수 있습니다.

- RAG와 MRC의 결합을 통해 AI 시스템의 신뢰성과 도메인 특화 정확도를 높일 수 있습니다.

- AI 기술의 실질적인 산업 적용 및 상용화 가능성을 높입니다.

조직 차원의 신뢰성 확보 노력 (포티투마루)

- CAT 인증: 국내 최초로 정확도, 보안, 설명 가능성, 프라이버시 등 15개 항목을 평가하는 AI 신뢰성 인증 'CAT'를 획득했습니다.

- TTA 가이드라인 참여: 한국정보통신기술협회(TTA)의 '신뢰할 수 있는 인공지능 개발 가이드' 제작에 참여했습니다.

- 로우코드 품질 점검 도구: 비개발자도 활용 가능한 자체 개발 도구를 운영합니다.

- 생성형 레드팀 챌린지: 외부 개발자가 시스템을 검증하는 공개 실험을 진행하며 실시간 피드백을 반영합니다.

커뮤니티 반응

원문에는 개발 커뮤니티의 직접적인 반응이 언급되지 않았습니다.

톤앤매너

본 콘텐츠는 AI 기술의 현재 한계점과 발전 방향에 대한 전문적이고 객관적인 분석을 제공합니다.

📚 관련 자료

LangChain

LLM 기반 애플리케이션 개발을 위한 프레임워크로, RAG 구현 등 LLM의 한계를 극복하고 정확성을 높이는 다양한 기술적 접근 방식을 지원합니다. 본 콘텐츠에서 언급된 RAG와 LLM 연동에 대한 실제 구현 사례를 참고할 수 있습니다.

관련도: 90%

Hugging Face Transformers

다양한 사전 훈련된 언어 모델(LLM 포함)을 제공하며, NLP 연구 및 개발에 필수적인 라이브러리입니다. LLM의 작동 방식과 한계를 이해하고, 더 정확하고 신뢰할 수 있는 모델을 구축하거나 활용하는 데 필요한 기반 기술을 제공합니다.

관련도: 85%

Haystack

NLP 모델을 위한 오픈소스 프레임워크로, 특히 검색(Retrieval)과 답변 생성(Generation)을 결합하는 RAG 파이프라인 구축에 특화되어 있습니다. LLM의 환각 현상을 줄이고 정보 검색 능력을 강화하는 데 초점을 맞추고 있어 본 콘텐츠의 RAG 설명과 직접적인 연관성이 높습니다.

관련도: 80%