CORE 소개 - LLM을 위한 오픈소스, 공유 가능, 사용자 소유 메모리 그래프

카테고리

프로그래밍/소프트웨어 개발

서브카테고리

인공지능

대상자

LLM(대규모 언어 모델) 개발자, AI 연구자, 팀 협업 엔지니어

난이도: 중간 (Docker 및 명령줄 도구 기본 지식 필요)

핵심 요약

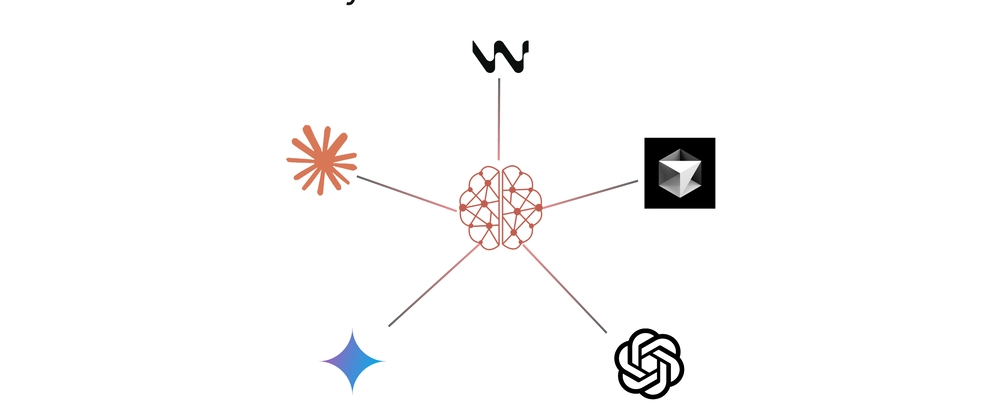

- CORE는 LLM 간 공유 가능한 사용자 소유 메모리 그래프로,

ChatGPT,Cursor,Claude등 다양한 모델이 동일한 지속 가능한 컨텍스트를 공유 가능 - 100% 사용자 소유 데이터 - 저장/검색 권한은 사용자에게 있으며, 모든 사실에

who, when, why기반의 전체 버전 이력 제공 - 로컬 실행 단계:

.env파일 생성 →docker-compose up→http://localhost:3000접속 →Magic Link로그인 → 메모리 공간 생성 및 데이터 수집

섹션별 세부 요약

1. 문제 정의 및 CORE 개념

- LLM 간 컨텍스트 공유의 어려움 (예:

Cursor는 기억하지 못함,Claude는 매번 초기화) - CORE는

Shareable,Relational,User-owned3가지 핵심 기능을 통한 메모리 그래프 구현 - 사용자 데이터 소유권 보장 및 버전 관리 기능 제공

2. CORE Cloud 및 로컬 실행 방법

https://core.heysol.ai에서 무료 체험 가능 (유료 전환 시점까지)- 로컬 실행 절차:

.env파일 생성 (cp .env.example .env)docker-compose up으로 서비스 실행http://localhost:3000접속 후Magic Link로그인- 대시보드에서 메모리 공간 생성 및 데이터 수집 (예:

I love playing badminton입력)

3. 사용자 주의사항 및 제한

Llama기반 모델과의 호환성 개선 중 (현재 최적화된 결과 제공 불가)- 데이터 처리 상태는

server logs에서 확인 가능 - 메모리 노드는

private knowledge graph에 저장되며, 외부 도구 연결 여부 선택 가능

결론

CORE는 LLM 간 지속 가능한 컨텍스트 공유를 위한 혁신적인 도구로,Docker기반의 간단한 설치 절차와Magic Link인증 방식으로 빠른 시작 가능Llama모델 호환성은 향후 개선 예정이므로, 현재는ChatGPT,Cursor,Claude등과의 호환성에 집중할 것 권장- 공식 문서(https://core.heysol.ai)에서 보다 상세한 기술 스펙 및 사용법 확인 가능